1、原理

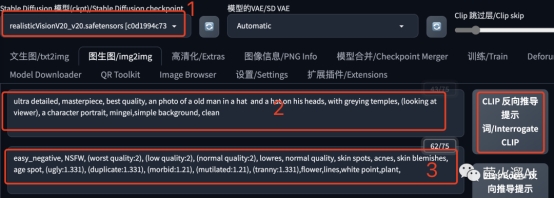

这个方法需要一个真实模型,以便让修复的照片看起来比较像,我这里选择:realisticVisionV20,大家有更好的给我推荐哦。

还需用搭配两个特殊设置:

ControlNet Tile:这是一个ControlNet模型,用于放大和补充细节。

ADetailer:这是一个插件,用于修复人脸,也需要加载对应的模型。

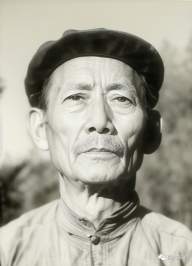

我从网上找了一张比较模糊的照片(如有侵权,请告知替换)。

2、实操

打开Stable Diffusion WebUI,进入“图生图”界面。

(1)选择好大模型,填写合适的提示词和反向提示词。

注意提示词需要匹配照片。不会写的同学,可以使用WebUI中的反向推导工具先生成一个,然后再进行修改,我这里贴出这张图的提示词:

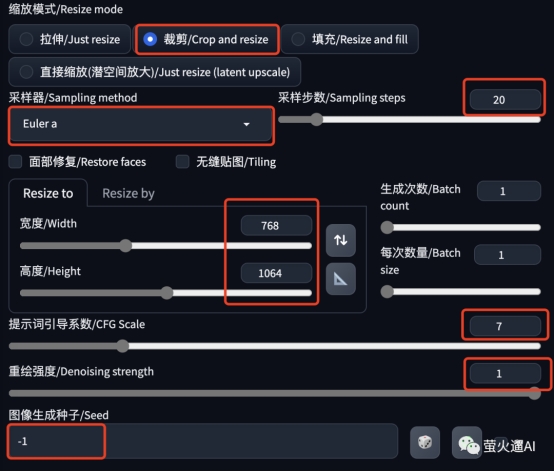

(2)基础生成参数设置。

图生图这里上传待修复的图片:

缩放模式:裁剪,不改变尺寸的情况下这个没影响,改变尺寸的时候会截取。

采样器:Euler a

采样步数;20

尺寸:768*1064,想要出图的尺寸,一般原图尺寸就可以,生成好了再裁减。

提示词引导系数:7,这是默认值,出图不满意的时候可以调整试试。

重绘强度:这里选择1,以更好的补充细节,可以根据实际情况调整 。

图像生成种子:-1,代表随机种子,建议不要固定,否则每次出来的都一样。

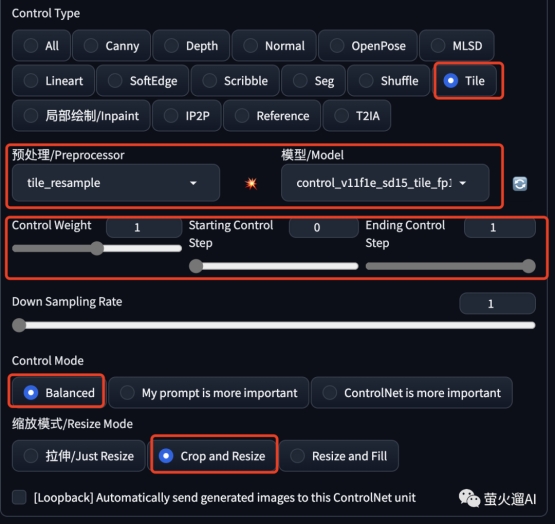

(3)设置ControlNet Unit

在第一个Unit中上传原图;勾选“启用”,否则ControlNet不生效;勾选“Pixel Perfect”,勾选“Allow Preview”。

这里选择Control类型为 Tile,注意预处理器和模型都要对应上,都是包含tile的,一般WebUI会自动选择上,没有自动的需要自己选择;

Control Weight 用来控制Tile的权重;

Starting Control Step 和 Ending Control Step 用来控制ControlNet介入图像生成的步骤。

如果想让SD更自由发挥一下,可以调整下权重和介入步数,这里采用默认值。

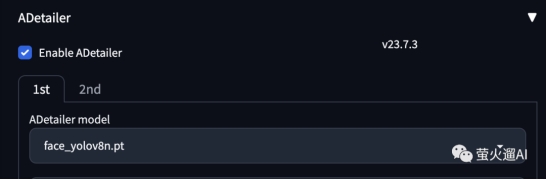

(4)修脸插件

对于修复大爷的照片,这里感觉没什么用,如果生成效果不好的话,可以试试它。

(5)最后点击生成,看看效果,还不错!

3、相关下载

·

修脸插件:看我另一篇文章,其中有提到人像插件的安装方法。

·

·

模型:关注公众号:萤火遛AI(yinghuo6ai), 发消息:真实模型。

·

·

OK,以上就是本文的主要内容,感谢阅读。

出自:https://mp.weixin.qq.com/s/DnHr28IgJZlobZ10a9CKoA