本文介绍了一种名为“Induction-Augmented

Generation(IAG)”的框架,用于回答推理问题。该框架结合了归纳知识和检索文档,并利用大型语言模型(LLM)通过一种基于归纳推理模式的新提示方法生成这种知识。作者提出了两个版本的IAG:IAG-GPT直接使用GPT-3生成的知识进行答案预测,而IAG-Student则通过知识蒸馏训练一个学生归纳器模型,并通过可微分束分数反向传播生成器反馈进一步优化。实验结果表明,IAG在两个开放域问答任务上优于RAG基准线以及ChatGPT。值得注意的是,作者的最佳模型已经在官方排行榜中获得了第一名。

论文方法

方法描述

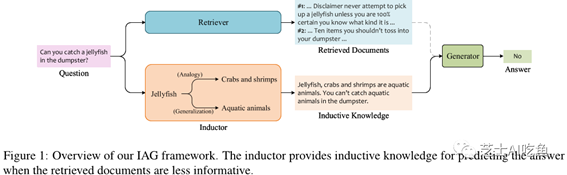

本文提出了一个名为Inductive

Answer Generation(IAG)的新框架,用于增强基于预训练模型的问答系统性能。该框架通过在输入问题后添加一个诱导器来引导模型预测答案,从而增强系统的事实准确性。具体而言,IAG框架包括两个实现:IAG-GPT和IAG-Student。其中,IAG-GPT使用GPT-3作为诱导器,并利用多个知识陈述来提高结果的可靠性;而IAG-Student则将GPT-3替换为一个学生诱导器模型,通过训练策略进一步优化其性能。

方法改进

与传统的基于预训练模型的问答系统相比,IAG框架的主要优势在于其增强了系统的事实准确性。这是通过引入一个诱导器来实现的,它能够根据给定的问题生成一系列相关的知识陈述。这些知识陈述可以有效地帮助模型理解问题并预测正确的答案。此外,IAG框架还提供了一些额外的优势,例如:

对于IAG-GPT,通过聚合多个知识陈述来提高结果的可靠性;

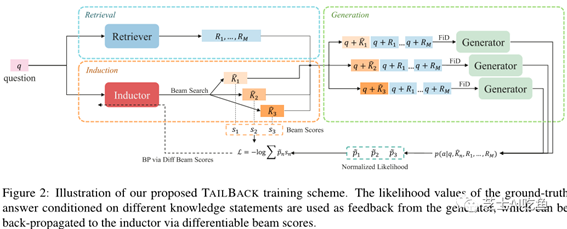

对于IAG-Student,通过使用一种新颖的训练策略来进一步优化学生诱导器模型的性能。

解决的问题

IAG框架旨在解决基于预训练模型的问答系统中存在的一个问题,即它们可能无法准确地处理某些问题,因为它们缺乏足够的背景知识。通过引入一个诱导器来生成相关的知识陈述,IAG框架可以帮助模型更好地理解问题并预测正确的答案。这有助于提高系统的事实准确性,并使其更适用于各种实际应用场景。

论文实验

本文主要介绍了信息引导生成(Information

Guided Generation,简称IAG)框架在两个开放域问答任务上的表现,并与当前的SOTA模型进行了比较。具体来说,本文针对CSQA2.0和StrategyQA两个任务,采用了不同的模型架构和训练方法,并对不同的组件进行了优化和调整。下面将分别介绍每个对比实验的具体内容:

o

主要结果

o

首先,本文比较了IAG-GPT和SOTA模型在两个任务上的表现。结果显示,IAG-GPT相比于SOTA模型有显著的提升,尤其是在CSQA2.0任务上,从74.1提高到了78.2,在StrategyQA任务上,从69.4提高到了72.9。此外,IAG-GPT在回答推理问题方面也表现出更好的效果,比ChatGPT等更强大的模型更加可靠。这些结果表明,通过结合信息检索和提示方法,可以更好地利用预训练语言模型来解决问答任务。

o

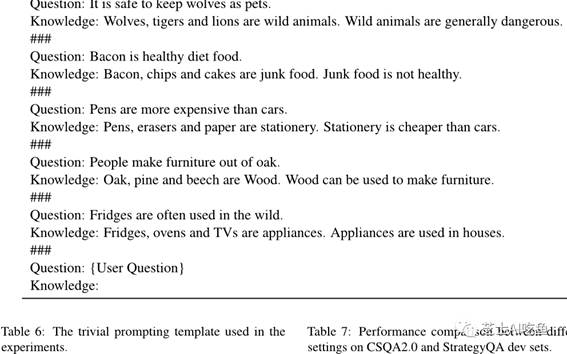

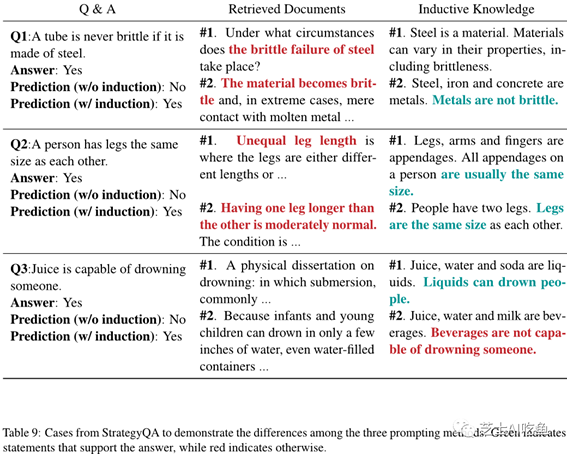

提示方法

o

为了验证IAG框架的有效性,本文还与其他两种提示方法进行了比较。第一种是使用简单的提示来询问知识,第二种是直接使用CoT方法来提取答案。实验结果表明,IAG框架比CoT方法更为有效,因为它不仅依赖于预训练语言模型本身的能力,还可以结合信息检索的结果来进行预测。同时,诱导式提示方法也比简单提示方法更能提供有用的线索。

o

优化器

o

对于IAG-Student模型,本文采用了两步训练策略来优化它的性能。实验结果表明,使用QWeight策略可以获得最佳的性能,因为这种策略能够平衡不同知识陈述之间的贡献,并抑制低质量的知识陈述的影响。此外,本文还研究了不同数量的知识陈述对性能的影响,结果表明,5到7个知识陈述之间是一个合理的折中点。

综上所述,本文通过对多个对比实验的分析,证明了IAG框架在问答任务中的有效性,并提出了一些优化策略。这些结果为后续的研究提供了参考。

论文总结

文章优点

该论文提出了一种新的框架IAG(Induction-Augmented Generation),结合了信息检索和基于语言模型的知识提取两种方法的优点,用于回答隐含推理问题。具体来说,IAG通过构建一个学习器来产生诱导知识,并使用链式思维等方法提高知识的真实性。作者还提出了一个新颖的优化方案,训练一个学生学习器模型,以实现无依赖于GPT服务的推断。实验结果表明,IAG在多个开放域问答数据集上优于SOTA模型,并在官方排行榜中获得了第一名。 此外,本文的研究思路清晰,实验设计合理,结果可重复性强,具有较高的学术价值。

方法创新点

本文的主要贡献在于提出了一种新的框架IAG,将信息检索和基于语言模型的知识提取相结合,用于解决隐含推理问题。同时,本文还提出了一种新颖的优化方案,即使用Tailback算法训练学生学习器模型,实现了无依赖于GPT服务的推断。这些创新点为后续相关研究提供了有益的参考和借鉴。

未来展望

虽然本文提出的IAG框架已经取得了显著的成果,但仍然存在一些限制和挑战。例如,IAG的效果受到LSTM模型大小的限制,需要进一步探索如何利用更大规模的语言模型来提高性能;另外,IAG还需要更多的数据和任务来进行验证和评估。因此,在未来的研究中,可以考虑将IAG与其他技术相结合,如迁移学习、多模态融合等,以进一步提升其性能和适用范围。

出自:https://mp.weixin.qq.com/s/9sL6Ts4fAFHuwJicXU2ijw