Nvidia推出Llama3-ChatQA-1.5,一款超越GPT-4的对话问答模型,融合会话式问答和表格推理能力,通过高质量数据训练,无需ChatGPT合成数据,检索增强能力强大,小尺寸高性能,适合边缘设备部署,将支撑未来对话式AI应用。模型可在Huggingface和AI快站下载。

前言

近日,Nvidia推出了一款名为Llama3-ChatQA-1.5的对话问答模型。该模型在对话式问答和检索增强型生成等能力方面表现出色,在综合评测指标上甚至超越了当前业界顶尖的GPT-4模型。

技术特点

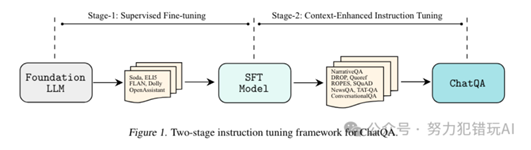

Llama3-ChatQA-1.5是基于Llama-3基础模型训练而成的。相比之前的ChatQA

1.0版本,其训练方法和数据集都进行了优化,尤其增强了对表格数据和算术计算的理解能力。该模型有两个不同规模的版本:Llama3-ChatQA-1.5-8B和Llama3-ChatQA-1.5-70B。

·

Huggingface模型下载:https://huggingface.co/nvidia/Llama3-ChatQA-1.5-8B

·

·

AI快站模型免费加速下载:https://aifasthub.com/models/nvidia

·

·

Llama3-ChatQA-1.5的创新点主要体现在以下几个方面:

·

融合会话式问答和表格推理能力:该模型不仅擅长处理开放域的对话式问答,在理解和推理包含表格数据的复杂问题上也有出色表现。

·

·

依靠高质量数据训练,无需借助ChatGPT合成数据:Llama3-ChatQA-1.5的训练数据主要来自人工标注的会话式问答数据集以及其他高质量QA数据,并未使用ChatGPT等模型生成的合成数据。

·

·

检索增强能力强劲:通过对单轮检索模型的精细调优,Llama3-ChatQA-1.5能够高效利用检索结果,在需要检索的场景下也能保持出色的性能。

·

性能表现

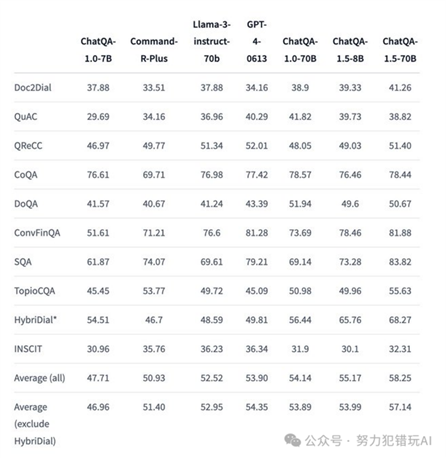

采用ChatRAG Bench基准评测套件,对Llama3-ChatQA-1.5系列模型进行了全面测试,结果如下:

从结果可以看到,Llama3-ChatQA-1.5-70B在10个数据集上的平均得分达到58.25,超越了GPT-4的53.90分,尤其在包含表格数据的数据集上表现更为出色。即使参数量较小的Llama3-ChatQA-1.5-8B,在整体指标上也超过了其他对比模型。

应用场景

Llama3-ChatQA-1.5的小尺寸和高性能使其非常适合部署在资源受限的环境中,如边缘设备。同时,该模型融合了会话理解、表格推理和检索增强等关键能力,可为未来的对话式AI应用提供强有力的支撑。

总结

Nvidia发布的Llama3-ChatQA-1.5是一款融合了对话问答和表格推理能力的高性能模型,在多个评测基准上的平均表现超越了当前最强的GPT-4模型。该模型的创新点包括依靠高质量数据训练、检索增强能力强劲等,展现了Nvidia在对话式问答领域的技术实力。作为一款小尺寸高性能的模型,Llama3-ChatQA-1.5必将成为未来对话式AI应用的重要支撑。

模型下载

HuggingFace

https://huggingface.co/nvidia/Llama3-ChatQA-1.5-8B

AI快站模型免费加速下载

https://aifasthub.com/models/nvidia

出自:https://mp.weixin.qq.com/s/lOUAgLGCX5j2iwJQkT2R5A

本文档由网友提供,仅限参考学习,如有不妥或产生版权问题,请联系我们及时删除。

客服请加微信:skillupvip